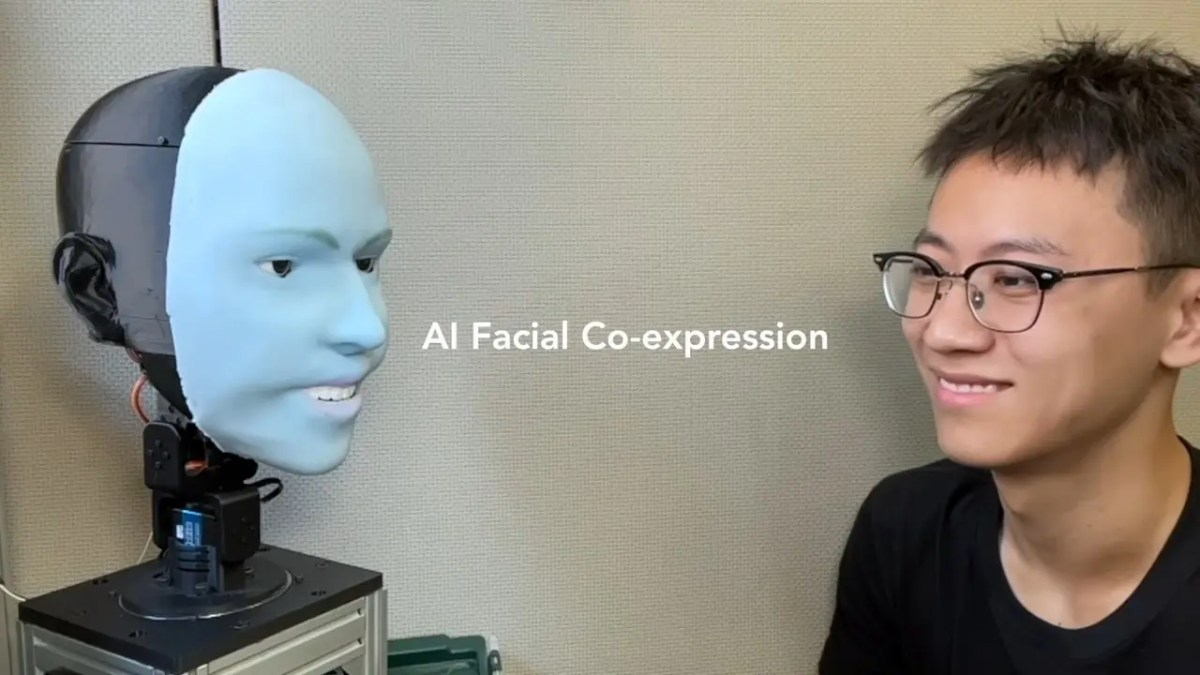

你能想像嗎?當你走近一個有著擬真臉孔的機器人,你正想對它表示友好時,它竟然早你一步露出微笑並且對你打招呼。由哥倫比亞大學工學院創意機器研究室(Creative Machines Lab)費時五年打造的機器人Emo,在最新發布的研究中登場。Emo不僅能進行眼神交流,還能透過兩種AI模型預測並模仿人類的臉部表情。這技術不僅讓機器人懂得「讀空氣」,也為人與機器人之間的互動和信任搭建了新橋樑。

Emo背後的AI技術

要打造一個能夠準確模仿人類微笑的機器人面孔可沒那麼容易。研究團隊不僅需要設計出能夠執行複雜表情的致動器,還要確保這些表情看起來自然且及時。他們為Emo裝配了26個精密致動器,每一個都負責模擬人類臉部肌肉的微小動作,從而使得Emo能夠展現出從微笑到驚訝等多種表情。此外,Emo的眼睛裝有高解析度鏡頭,這不僅讓它能夠與人類進行極為真實的眼神交流,還幫助它捕捉到眼前的每一個細微表情變化。

為了讓Emo的反應不僅快速而且準確,哥倫比亞大學的研究團隊開發了兩種AI模型。第一個模型專門用於分析人臉的微小變化,從而預測即將形成的表情。這使得Emo能夠捕捉到如微笑的起始動作,並在表情完全展現之前作出反應。第二個模型則根據第一個模型的分析結果生成相應的致動器命令,使Emo能夠在人類微笑之前約840毫秒預測並同步展示微笑。

Emo也透過照鏡子練習表情?

研究團隊採用了一種稱為「自我模型化」(self modeling)的方法來訓練Emo。這種方法使Emo能夠透過觀察自己產生的隨機臉部動作,以及這些表情與致動器之間的對應關係。透過這個過程,Emo不斷調整並建立了一個內部模型,這個模型詳細描述了不同致動器配置如何影響臉部表情的變化,類似於人類在鏡子前練習不同臉部表情的過程。

Emo用這種自我觀察的方式,便能無需外部參照,自行最佳化表情的準確性和自然度。隨後,再透過觀察大量的人類臉部表情影片,讓Emo能夠學習並記住特定表情的觸發條件和適當時機。

未來,研究團隊計劃將Emo與其他大型語言模型,如GPT整合,進一步提升其語言理解與互動能力。這將使Emo能更深入地參與對話,準確理解語境並洞悉情感。當然,擁有高共感能力的機器人實在讓人既期待又怕受傷害,人類會不會就像《人造意識》裡的劇情一樣,被機器人的生動演技騙得團團轉呢?